| HIFI-FORUM » Fernseher & Beamer » Projektoren / Beamer » Digitale Konvergenzkorrektur - Zonenweise - welche... | |

|

|

||||

Digitale Konvergenzkorrektur - Zonenweise - welche Nachteile gibt es?+A -A |

|||||||

| Autor |

| ||||||

|

hotred

Inventar |

#1

erstellt: 01. Nov 2021, 14:30

|

||||||

|

Dieses Thema interessiert mich schon länger und es ist auch mehr oder weniger immer "präsent" bei den 3-Chip Geräten, deshalb denke ich macht es absolut Sinn das losgelöst von einzelnen Geräten in einem eigenen Thread zu behandeln. Bekanntlich "leiden" 3-Chip Beamer wie es LCD und LCOS Geräte prinzipbedingt sind nahezu IMMER an mehr oder weniger starken Abweichungen der Konvergenz - also der Deckungsgleichheit der 3 bildgebenden Panel für RotGrünBlau. Aufgrund dieses Umstandes verfügen nahezu alle 3-Chip Geräte über eine digitale Konvergenzkorrektur. Digital deshalb, da die physische Lage der Panel ja natürlich NICHT beeinflusst wird bzw. beeinflusst werden kann durch den user. Eine mechanische Konvergenzkorrektur (wie es eigentlich "korrekt" wäre) bieten nur manche große Geräte aus dem professionellen Bereich bzw. sehr teure "Exoten" aus dem "semi-pro" Bereich. Nun liegt auf der Hand das eine digitale Korrektur erstmal nicht so "ideal" ist wie eine mechanische - aber natürlich sehr viel besser als überhaupt keine... Die Konvergenzkorrekturmöglichkeit unterteilt sich gewöhnlich in 2 Bereiche: Die GESAMTE - bzw. "globale" Korrektur oder Die ZONEN Korrektur. Die Notwendigkeit für die Eine - oder Andere Variante ergibt sich erstmal durch das Gerät selber bzw. dessen Konvergenzabweichung. Wenn man "Glück" hat - so sind die Panel nur vertikal oder horizontal zueinander um zb. eine Pixelreihe verschoben. Das ist kein Problem - denn dann reicht die "GESAMT" Korrektur und man passt es einfach an und gut. Etwas problematischer ist dann wenn die Abweichung zb. nur ein halbes Pixel beträgt - damit kann man dann entweder leben oder versucht mit der Zonenkorrektur ein besseres Ergebnis zu erhalten ("Fein" Einstellung) Sehr viel problematischer jedoch ist eine Abweichung um die Hochachse der Panel - d.h. die Panel sind (minimal) zueinander "gedreht". In diesem Fall kann die "GESAMT" Korrektur natürlich nicht angewendet werden - da zb. am linken Bildrand blau zu hoch ist und am rechten Bildrand zu tief. In der Mitte auf Linie... Für diesen Fall gibt es die "ZONEN" Korrektur. Die Auswirkungen auf das Bild unterscheiden sich bei den beiden Arten grundsätzlich - denn während bei der "GESAMT" Variante nicht direkt am Bild "gedreht" werden muss und einfach zb. die blauen Pixel horizontal oder vertikal um eine ganze "Zeile" verschoben werden - geht das bei der Zonenbasierten Regelung in dieser (einfacheren) Art nicht da es sich ja hier nicht um eine einfache Verschiebung einer ganzen Reihe handelt sondern die Verschiebung der Pixel hier wie der Name vermuten lässt Zonenweise passiert und ebenso auch die Berechnung der Verschiebung der Pixel von der Elektronik des Beamer dann Zonenweise geschehen muss. Natürlich sollte man erstmal immer versuchen mit der "GESAMT" Einstellung das beste Ergebnis zu justieren. Der Beamer sollte dafür natürlich seine "Endtemperatur" erreicht haben und auch die Aufstellung und vor Allem auch das Lens Shift sollte sich in der am öftesten genutzten Konfiguration befinden. Wenn das geschafft ist, sollte man sicherstellen das bei E-Shift Geräten das E-Shift "OFF" ist (keine 4K Zuspielung!!! UND E-Shift off). Im Anschluss sollte sichergestellt sein das die Schärfe perfekt justiert ist - die meisten 3-Chip Geräte haben Motoroptik, das sollte also direkt an der Leinwand erfolgen. Dabei auch unbedingt darauf achten das der Beamer nicht um die Hochachse verdreht ist zur Leinwand - denn das kann eine ungleichmäßige Schärfeverteilung bewirken (sollte aber bei der Anpassung an die Leinwand aufgrund des dadurch entstehenden Trapezeffekt auffallen) Wenn die Schärfe und Schärfeverteilung gecheckt ist (100% sind hier kaum möglich...) - so kann man sich daran machen die Konvergenz mit der "Gesamt" Korrektur einzustellen (falls nötig). Die Zonenkorrektur sollte erst im Anschluss daran erfolgen, auch für einen weiteren Lens Memory Speicher sollte man die Konvergenz kontrollieren und ggfs. wenn nötig nachjustieren und abspeichern. Und nun kommen wir (endlich...) zum topic dieses Thread: WAS PASSIERT DA?!?     Wenn man nun die Zonenkorrektur ausgiebig nutzt (wie das manche user machen) - so bedeutet das am Ende relativ viel Rechenaufwand für den Beamer wenn dieser das Bild zerlegt in viele Zonen "zurechtbiegen" muss um seine mechanischen Mängel zu verschleiern. Die Frage ist nun: Ist jemandem schon ein sichtbarer Nachteil dadurch aufgefallen? Die Konvergenzkorrektur lässt sich ja gewöhnlich abspeichern auf verschiedenen Speicher und auch abschalten - man kann also nach Lust und Laune vergleichen. Also, Feuer frei für Erfahrungen... [Beitrag von hotred am 01. Nov 2021, 14:32 bearbeitet] |

|||||||

|

Mankra

Inventar |

#2

erstellt: 02. Nov 2021, 15:48

|

||||||

|

Ich glaub, das Pixel verschieben ist das kleinste Problem: Jeder Pixel wird sowieso bei unterschiedlichen Auflösungen, Gamma-Kurven, Farbräumen, Farbeinstellungen, Kalibrierungen, bei der "Wide" Einstellung der 4K Geräten, bei aktiver FI, usw. analysiert und neu berechnet. Deshalb ist die Zonen weise Konvergenzkorrektur um ganze Pixel, der Verschub von Pixeln, wohl das geringste Problem für die Elektronik. Die Frage ist "nur", ob bei besonderen Mustern, Schraffuren, etc. auffällt, wenn es bei einer Zone einen Verschub eingestellt wird? Auf der einen Seite eine Pixelreihe eingefügt werden muss, auf der anderen Seite eine Pixelreihe weg fällt? Kritischer als die Zonenweise Konvergenzkorrektur sehe ich die Sub-Pixel-Konvergenzkorrektur: Unabhängig ob übers ganze Bild oder Zonen: Das kann ja nur über die Manipulation der Farben geschehen. D.h. selbst wenn bei größeren Flächen die Farben stimmen, die Kalibrierung OK ist, dürfte sich das bei kleineren Mustern Farb-Verfälschend auswirken. |

|||||||

|

|

|||||||

|

*Harry*

Inventar |

#3

erstellt: 02. Nov 2021, 19:49

|

||||||

|

Hottes Tagesordnung oben ist leider unvollständig, daher hier noch in Ergänzung:  <<< ZONENBASIERTE KONVERGENZKORREKTUR - EINE EINSTELLUNGSTECHNIK FÜR FORTGESCHRITTENE >>> <<< ZONENBASIERTE KONVERGENZKORREKTUR - EINE EINSTELLUNGSTECHNIK FÜR FORTGESCHRITTENE >>>Zur Bewältigung dieser gewissenhaften Aufgabe ist eine entsprechende Veranlagung von Natur aus erforderlich.    |

|||||||

|

*Harry*

Inventar |

#4

erstellt: 02. Nov 2021, 21:23

|

||||||

Es findet immer eine Sub-Pixel-Korrektur statt, was anderes passiert da nicht. Du kannst nicht "weiß" verschieben, sondern nur rot und/oder blau. Grün ist fix. Es passiert also keine Farbenmanipulation - da wird einfach nur ein Sub-Farbpixel zum nächsten gleichfarbigen überblendet, d. h. es verringert sich die Luminanz vom Original-Pixel und der nächste in Zielrichtung beginnt zu leuchten. Sieht man ja ganz klar, wenn man es durchführt. Doof ist halt, wenn von einem eigentlich weißen Pixel z.B. rot halbert daneben leuchtet, es dann unkorriegiert und bei naher Betrachtung dieses einen Pixels dann schon zu einer Farbverfälschung kommt. Daher macht man bei der Korrektur aus einem roten Pixel 2 halbhelle, was dann wieder ein sauberes "weißes" Pixel ergibt, da die beiden anderen (grün und blau) ja auf gleicher Position liegen. Unser Auge kann den Schummel ab einem geringen Abstand schon nicht mehr bemerken; das haben die JVC-Leute dabei bedacht. Denkt man genauer darüber nach, kommt einem schon mal der Gedanke: Was passiert eigentlich, wenn man in H oder V-Achse einen kompletten Pixel verschubbsen musste? Angenommen links am LW-Rand eines FullHD-Beamers passt alles, die R|G|B-Pixel liegen super übereinander, aber kurz vor dem rechten Bildrand leuchtet Rot um einen Pixel versetzt rechts neben Grün -> man muss dort also Rot um einen Pixel nach links schieben, d. h. bei Full-HD wird Pixel "1920" dunkel geschaltet und statt dessen leuchtet dann der bei Adresse "1919" -> es geht also irgendwie ein Filmpixel flöten, der durch fließenden Übergang bis zum linken Bildrand mit einem anderen verheiratet wird. Umgekehrt: Liegt der rote Strahl am rechten Bildrand links vom Grünen, muss man ihn logischerweise nach rechts verschieben, d. h. Pixel "Rot" von Adresse "1920" muss bei "1921" leuchten (was die FW aber nicht macht). Es würden also mit Korrektur 1921 Pixel je Zeile benötigt -> da ein FullHD-Film aber nur 1920 Pixel je Zeile hat, muss ja irgendwie eine "Dehnung" her, bis ein Pixel herausgeholt wird. Aber egal ob ein Pixel verloren geht, oder einer hinzugedichtet werden muss - das sieht man im Filmbild keinesfalls. Nur in einem Gitterraster-Testbild mit sw/ws-Punkten von 1 Pixel Breite (diagonal versetzt) kann man sowas bemerken, und auch nur in diesem speziellen vollflächigen Testbild sehe ich bei aktivierter Konv.-Korr. geringfügige Farbwolken, wo eigentlich vollflächige Graufläche sein sollte. Allerdings ist von einem dauerhaft starren Blick auf dieses ganz spezielle Testbild abzuraten ... denn zum bestimmungsgemäßen Betrieb eines Beamers kaufe man idealerweise auch mal einen Film, sofern das Heimkino-Budget nicht zu 120% durch die Anschaffung von Kalibrierequipment ruiniert wurde.   |

|||||||

|

Mankra

Inventar |

#5

erstellt: 03. Nov 2021, 11:28

|

||||||

|

Das Eine ist die klassische Konvergenzkorrektur, welche R oder B oder G um ganze Pixel verschiebt. Mit "Subpixel" (ja ich sehe, jetzt auch, dass dies unglücklich gewählt war) Einstellung meinte ich, die Konvergenzverstellung nicht über ganze Pixelbreiten, sondern um halbe oder viertel Pixelbreiten. Irgendwo las ich, dass manche Geräte dies anbieten. Dies kann wohl nur über irgendwelche Farbmischung geschehen. Ja, klar verliert man mit dem LS eine oder 2 Pixelreihen am Rand. Wahrscheinlich werden die Geräte diese Pixelreihe aufdoppeln. Am Bildrand egal. Beim Zonenweisen Verschub, hat man das Problem mitten im Bild. Hier wird es zumindest bei Standbildern und dementsprechenden Mustern schon auffallen. |

|||||||

|

*Harry*

Inventar |

#6

erstellt: 04. Nov 2021, 13:51

|

||||||

Also beim JVC gibt es keine Farbmischung. Unter Farbmischung verstehe ich die Vermischung unterschiedlicher Farben. Wie gesagt, passiert bei der X-Serie die Konvergenzkorrektur einer Pixelfarbe per Überblendungsvorgang zum nächsten gleichfarbigen nativ-Pixel. Sie ist je Richtung in 16 Schritten aufgelöst möglich, bis das zu korrigierende rote oder blaue Pixel komplett dunkel und das benachbarte komplett hell leuchtet. In den Werten dazwischen leuchten diese beiden benachbarten Pixel eben mehr/weniger/gleich hell zur selben Zeit. Das bezieht sich bei der zonenbasierten Feinjustage natürlich erstmal auf die Pixel, die exakt in der Mitte der zu korrigierenden Zone liegen (also im Fadenkreuz); sind nun durch die zonenbasierte Justage benachbarte Zonen unterschiedlich korrigiert, dann kümmert sich die FW natürlich um eine fließende Versatz-Angleichung aller Pixel zw. Zone A zu B. Wie gesagt, das geschieht rein auf Farbpixel-Ebene, also Rot oder Blau. Und weil da eigentlich auf die komplette LW betrachtet von Zone zu Zone nur ein geringfügiges Korrektur-Delta besteht (es wird i.d.R. entw. um 1/16 ... 3/16 Pixelversatz mehr oder weniger), sieht man davon im Filmbild wirklich nichts (außer dass es eben wieder an "Schärfe" gewinnt). Ist im User-Menü nicht "Fein" eingestellt, dann geht das mit den 16 Übergangsstufen natürlich auch gleich vollflächig bei Rot+Blau. Was hast Du eigentlich für einen Beamer? |

|||||||

|

Mankra

Inventar |

#7

erstellt: 04. Nov 2021, 19:33

|

||||||

|

Ich hatte zuletzt einen X7900 und nun einen N5. Unabhängig vom Beamer-Modell und ob vollflächig oder Zonen-weise: Die Konvergenzkorrektur kann physikalisch nur in ganzen Pixeln geschehen: Die Geräte können keine halben oder viertel Pixel(breiten) ein oder ausschalten, sondern nur ganze Pixel. Und so kann eine Korrektur, ein Versatz, nur in ganzen Pixel geschehen. Keine Ahnung, wie 1/16 Pixelversatz simuliert wird, IMHO kann dies nur durch eine Farbmanipulation geschehen. |

|||||||

|

Barchetta1966

Inventar |

#8

erstellt: 05. Nov 2021, 09:45

|

||||||

|

Ach was, so einfach machen die das ? Ich hatte jetzt echt in meiner jugendlichen Naivität angenommen, da würde irgendwas mechanisch verschoben  |

|||||||

|

Mankra

Inventar |

#9

erstellt: 05. Nov 2021, 10:31

|

||||||

|

Schön wäre es. Ne die Chips sind fix verklebt. Erst in den Pro Geräten sind die 3 Chips verstellbar verbaut und können per Schrauben perfekt ausgerichtet werden. |

|||||||

|

*Harry*

Inventar |

#10

erstellt: 05. Nov 2021, 11:04

|

||||||

Aber so steht es doch schon oben geschrieben. Es gibt nur eine Überblendung von einem nativ zum nächsten nativ-Pixel. Niemand sagt, dass irgend ein Pixel physikalisch seinen Platz verlässt -> der "optisch falsch platzierte" wird je nach Korrekturbedarf auf eine von 16 möglichen Stufen abgedimmt, der nächste natürlich umgekehrt entsr. hell geschaltet. Für eine Fläche bleibt das alte natürlich an. Sollte jetzt klar sein. |

|||||||

|

Barchetta1966

Inventar |

#11

erstellt: 05. Nov 2021, 11:36

|

||||||

|

Verflixt, hier werden ständig und mutwillig Auge und Gehirn übers Ohr gehauen...  |

|||||||

|

Mankra

Inventar |

#12

erstellt: 05. Nov 2021, 11:40

|

||||||

|

Du meinst, dass diese Teil-Pixel-Korrektur über die Helligkeit einer Primärfarbe geregelt wird? Im Prinzip, was ich auch meinte: Wenn für die Teil-Pixel Korrektur die Helligkeit einer der Primärfarben reduziert wird, dann wird auch die Farbe manipuliert und zumindest geht Helligkeit verloren. |

|||||||

|

Barchetta1966

Inventar |

#13

erstellt: 05. Nov 2021, 12:58

|

||||||

|

Ich meine, da werden Pixel teilweise oder ganz gedimmt und wir denken, da verschiebt sich etwas physisch. Wenn man jetzt noch über e-Shifting spricht, dann muss man feststellen, dass auch dort nur über eine schnelle Abfolge von Abbildungen unsere Sinne überfordert bzw. zu einer subjektiven Wahrnehmung quasi überlistet werden, die nicht 100% der Realität entspricht. Genauso ist es doch bei LED Lampen in Autos. Da wird nicht wirklich in klassischem Sinne die Spannung gedimmt, sondern nur ein ähnlicher Effekt erzielt, in dem rasend schnell unterschiedlich lang gepulst wird. Vielleicht habe ich jetzt ein paar Dinge zusammengematscht, die nicht 100% identisch sind. Aber dennoch geht es immer um eine Art von Sinnestäuschung  |

|||||||

|

Mankra

Inventar |

#14

erstellt: 05. Nov 2021, 14:15

|

||||||

|

Per PWM wird die Helligkeit bei DLP geregelt. Das ist aber etwas ganz Anderes. Wenn die Teil-Pixel-Konvergenzkorrektur wirklich über ein Dimming einzelner Farben geregelt wird, dann kommt es eben zu Farbverfälschungen, bzw. auf Kosten der Farbhelligkeit. |

|||||||

|

Barchetta1966

Inventar |

#15

erstellt: 05. Nov 2021, 14:30

|

||||||

|

Na ja, und wirklich schärfer wird das Bild dadurch sicher auch nicht. Hm, jetzt habe ich mir die Antwort selbst gegeben  Immerhin habe ich jetzt verstanden, warum die Feineinstellung das Bild "weicher" macht  Schön, dass wir darüber geredet haben  [Beitrag von Barchetta1966 am 05. Nov 2021, 14:31 bearbeitet] |

|||||||

|

FoLLgoTT

Stammgast |

#16

erstellt: 05. Nov 2021, 18:02

|

||||||

|

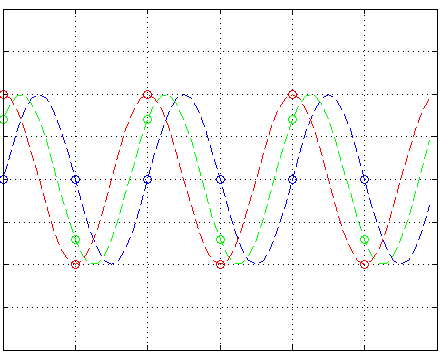

Die globale feine Konvergenzkorrektur ist nichts anderes als eine konstante Verzögerung der Ortsfrequenzen pro Farbkanal. Stellt euch einfach eine horizontale (oder vertikale) Linie als eine Wellenform vor mit der X-Achse als Länge und der Y-Achse als Intensität (analog Zeit und Pegel bei Audio). Gäbe es einen passenden analogen Tiefpass, würde auch die Wellenform wieder korrekt rekonstruiert werden. Das ist bei Digitalprojektoren natürlich nicht der Fall.  Sobald die Korrektur in Zonen angewendet wird, kommt eine Geometrieverzerrung dazu. Also das, was gängige Warpingboxen machen, nur eben pro Farbkanal separat. |

|||||||

|

Mankra

Inventar |

#17

erstellt: 05. Nov 2021, 18:25

|

||||||

|

Du meinst eine zeitliche Verzögerung? Und dadurch nimmt man den seitlichen Versatz weniger wahr? |

|||||||

|

FoLLgoTT

Stammgast |

#18

erstellt: 05. Nov 2021, 18:29

|

||||||

Nein, eine örtliche Verzögerung, also quasi eine Verschiebung nach links/rechts oder oben/unten. Die X-Achse der Wellenform verläuft ja entlang der Breite oder der Höhe. [Beitrag von FoLLgoTT am 05. Nov 2021, 18:29 bearbeitet] |

|||||||

|

FoLLgoTT

Stammgast |

#19

erstellt: 05. Nov 2021, 18:42

|

||||||

|

Hier noch mal ein anderes Beispiel. Die untere Wellenform ist etwas nach rechts verschoben gegenüber der oberen (also örtlich verzögert). Man achte auf den Ausschlag der Samples. Das sind beim Bild die Pixel, die natürlich nicht in Schallpegel gewandelt werden, sondern in Lichtstrom (bzw. Leuchtdichte auf der Leinwand) und um mittleres Grau schwingen. Eine Verschiebung sorgt dafür, dass zwei nebeneinander liegende Pixel plötzlich beide einen Wert größer Null aufweisen, dafür aber mit einem geringeren Wert als der Einzelpixel bei keiner Verschiebung.  [Beitrag von FoLLgoTT am 05. Nov 2021, 18:43 bearbeitet] |

|||||||

|

Mankra

Inventar |

#20

erstellt: 06. Nov 2021, 10:22

|

||||||

Da komme ich noch nicht mit: Mir ist klar, was eine Wellenform ist, bzw. Alles, was man mit einem Oszilloskop messen kann, ist eine zeitliche Aufnahme, z.b. Spannung steigt an, fällt ab, dreht die Richtung, Schallwellen: Luftdruck steigt an, fällt ab auf Normaldruck, Unterdruck baut sich auf, usw. Soweit klar. Wenn man bei Lautsprechern die Phase anpasst, dann ist das eine eindimensionale Anpassung, in Abstrahlrichtung. Früher oder später, zeitliche Anpassung, damit Alles gleichzeitig am Ohr ankommt. Soweit auch klar. Hier müssen wir 2 dimensional, quer zur Abstrahlung korrigieren, das ist ne andere Geschichte.

Aber doch nur auf der Anzeige, auf der Messung. Das ändert doch nicht den Ort des Pixels. Ok, Du schreibst, das Licht schwingt um das mittlere Grau. Du meinst also, ein weißer Pixel ist mal heller, mal dunkler dargestellt wird. OK. Aber das ist ja wieder eine zeitliche Funktion.  Wie soll sich der Ort ändern, nur weil die Helligkeitspulsierung zeitlich ändert?

Das klingt nun nach der Beschreibung unterschiedliche Pixel eine Durchschnittshelligkeit darstellen, eventuell, wenn Bilder Interpoliert werden, oder beim Shifting, wenn es zu Überlagerungen kommt. Das erklärt aber, IMHO, nicht, wie z.B. hier der Versatz des blauen Chips um einen halben PIxel korrigiert wird:  |

|||||||

|

FoLLgoTT

Stammgast |

#21

erstellt: 06. Nov 2021, 11:42

|

||||||

Vielleicht hilft es, sich ein bisschen in  Ortsfrequenzen (bzw. spatial frequencies auf Englisch) einzulesen. Das ist die Grundlage, um auf Bilder dieselbe Mathematik anwenden zu können wie auf Audio (z.B. Fouriertransformation). Ortsfrequenzen (bzw. spatial frequencies auf Englisch) einzulesen. Das ist die Grundlage, um auf Bilder dieselbe Mathematik anwenden zu können wie auf Audio (z.B. Fouriertransformation).

Genau, der Ort des Pixels (Sample) ändert sich nicht. Man muss hier in einer kontinuierlichen Welle denken, die durch die Pixel (Samples) quantisiert ist. Leider ist das beim digitalen Anzeigegerät nicht ganz so anschaulich, weil der Tiefpass am Ende der Rekonstruktion fehlt. Das ist in etwa so, wie wenn man bei Audio direkt die Samples ohne Tiefpass wiedergibt, was scheußliches Aliasing (-> "Treppenstufen") mit sich bringt. Das ist im Bild genauso vorhanden. Wir haben uns nur daran gewöhnt. Röhrenprojektoren haben das horizontal übrigens noch richtig gemacht. Und jetzt kommt das, was man wirklich verstehen muss: wenn es einen passenden Tiefpass gäbe, wäre die Farbe real und korrekt verschoben (siehe mein Bild weiter oben)! Das klappt eben nur so halbgar, weil der Tiefpass fehlt. Grundlage ist immer eine kontinuierliche Wellenform, die durch Samples quantisiert ist. Darauf basiert die Mathematik.

Nein, das meinte ich nicht. Ich meinte, dass der Nullpunkt im Vergleich zu z.B. Audiosignalen verschoben ist. Es gibt ja kein "negatives Licht". Wenn man sich eine Welle (z.B. die Bursts auf der Burosch) anschaut, dann sind die Amplituden Weiß (235) und Schwarz (16), der Nullpunkt das mittlere Grau. Der Sinus schwingt also um dieses Grau. Um das alles im Detail zu verstehen, braucht man einiges an Hintergrundwissen über die Signal- und Systemtheorie. Also Nyquist, Fourier usw. Letztendlich kann man mit den mathematischen Modellen dahinter jede Wellenform bearbeiten oder transformieren. Sei sie nun Zeit-Spannungs-basiert oder Ort-Intensitäts-basiert. Das spielt keine Rolle. Beim Bild hat man das Ganze eben nur zweidimensional (Höhe/Breite), was aber letztendlich auch nicht so schlimm ist, denn man kann sich das mit bestimmten Testbildern immer auf eine Dimension reduzieren. Und dann ist es auch wieder verständlicher (siehe Bursts). [Beitrag von FoLLgoTT am 06. Nov 2021, 11:46 bearbeitet] |

|||||||

|

George_Lucas

Inventar |

#22

erstellt: 06. Nov 2021, 14:29

|

||||||

|

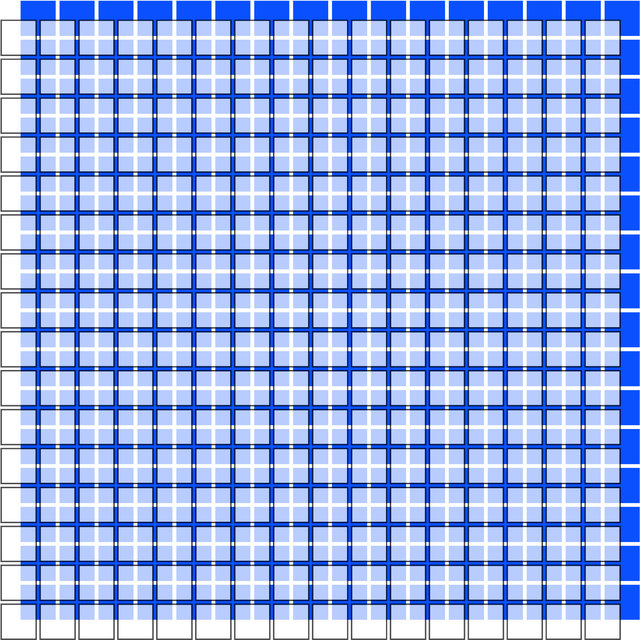

Um das mal in der Praxis zu veranschaulichen:  links: Ohne zonenbasierte Konvergenzkorrektur / rechts: Mit zonenbasierter Konvergenzkorrektur Genau aus diesem Grund rate ich davon ab, die zonenbasierte Konvergenzkorrektur zu verwenden. Darüber hinaus beobachte ich auch Unschärfen, die ohne zonenbasierte Konvergenzkorrektur nicht vorhanden sind. |

|||||||

|

hotred

Inventar |

#23

erstellt: 06. Nov 2021, 15:15

|

||||||

|

Ich hab hier:  http://www.hifi-foru...94&thread=16785#last http://www.hifi-foru...94&thread=16785#lastgerade nochmal ein Bild eingestellt von meinem Epson TW9400. Wenn das E-Shift an ist, wirkt sich das DEUTLICH auf die Farbhelligkeiten aus - das ganze Bild wirkt dann wie "abgedimmt" im Vergleich. Man kann das durch ein/aus sehr gut beobachten. Es sieht jedenfall ohne aktiver Konvergenzkorrektur DEUTLICH "stimmiger" und besser aus - jedenfall bei dem Testbild. Zum Glück ist das Gerät bzgl. Konvergenz nicht weit daneben - so das man die auch komplett aus lassen kann und es dann eigentlich nur vergrößert sieht auf dem Bild. Es fällt nicht mal bei dem "Testbild" mit freiem Auge wirklich auf - da muss man schon mit der Nase an der LW darauf achten. Also die Konvergenzkorrektur scheint nicht so "harmlos" zu sein wie bisher gedacht... Dabei hatte ich aber keine Zonen - sondern nur die "Gesamt" Korrektur aktiv. Ich müsste mir das aber nochmal im Detail ansehen was sich wann / wie auswirkt. |

|||||||

|

Mankra

Inventar |

#24

erstellt: 07. Nov 2021, 09:49

|

||||||

|

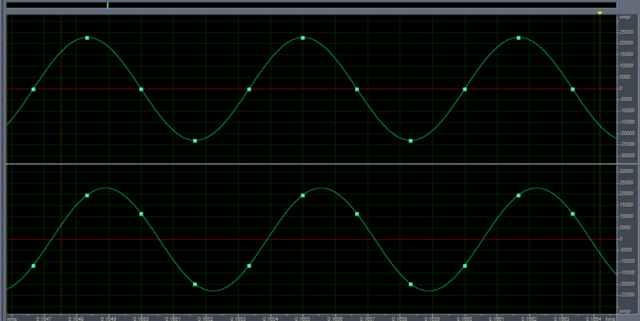

@Follgott: Was mit Ortfrequenz gemeint ist, ist mir auch bekannt, Stichwort "Pixelschärfe"  Trotzdem schaffe ich noch nicht den Gedankensprung, wie durch eine Phasenverschiebung (sind Verschiebungen im Thz Bereich wirklich sichtbar?) quer zur Bewegungsrichtung eine Verschiebung bringen soll. Ich glaub, ich hab das Rätsel gestern gelöst, zumindest für den N5: Gestern hab ich rund 2h mit der Einstellung diversen Einstellungen gespielt (leider schaffe ich es nicht, das 1px Schachbrett brauchbar darzustellen, siehe dazu auch  http://www.hifi-foru...d=16780&postID=25#25) und dabei wahrscheinlich das Rätsel gelöst: http://www.hifi-foru...d=16780&postID=25#25) und dabei wahrscheinlich das Rätsel gelöst:Mit der Einstellung "Pixel" wird die Darstellung der gewählten Farbe um ganze Pixel versetzt, hier gut zu sehen:  Wobei mir jetzt erst auffällt, dass die +2 Einstellung von Rot und Blau für das Foto das Ganze um 4 Pixel hoch geschoben hat....... Muss ich mir am Abend nochmal ansehen, Fein: +8 in eine Richtung scheint ein ganzer Pixel zu sein. Zumindest verfärben sich die Quadrate beim QFB Bild ab +1 und sind bei +8 wieder weiß. Testbild: Schwarzer Hintergrund, weiße, 1Pixel Linien: Grundsätzlich ist die Konvergenz über das ganze Bild sehr gut, einzig Rot ist waagrecht ein Problem: Ohne Korrektur: Überstrahlt nach oben Etwas 1px nach Unten überstrahlt nach unten Etwas. Also die Feinjustage: Heureka, die Linie wird schmaler, bei -4 bis -5 ist die Linie weiß. Keine Ahnung wie, aber es funktioniert. Kontrolle per weißem Bild mit schwarzen Linien: Autsch, was ist da los: starkes Überstrahlen in Türkis........ Fein Abstellung wieder zurück auf 0: Ok, jetzt ist das Türkis weg. Also es findet doch eine Farbmanipulation statt: Die Nebenpixel bekommen ein "Kompensationsfarbe", so dass z.B. aus dem Überstrahlendem Rot auf schwarzem Hintergrund ein Grau wird, weniger Sichtbar ist. Zumindest in dieser Konstellation. Bei Schwarz auf Weiß sieht man dies dann. Interessant ist, dass die Pixel-Verschiebung scheinbar in 2 Pixelschritten geschieht. Werde mir heute noch ansehen, was passiert, wenn ich Rot um 8 Punkte in der Feineinstellung verschiebe. Zonen, das eigentliche Thema, hab ich mir nicht angesehen, da die Konvergenz von Links bis Rechts gleich ausfällt. |

|||||||

|

FoLLgoTT

Stammgast |

#25

erstellt: 07. Nov 2021, 12:16

|

||||||

Eine Ortsfrequenz besitzt keine Zeitkomponente, nur eine örtliche. Und hier wird die Phasenverschiebung (bzw. kostante Verzögerung). Löse dich mal von dem, was ein D-ILA macht, um den Krempel zeitlich darzustellen. Das Konzept der Ortsfrequenzen lässt sich genauso auf ein ausgedrucktes Bild oder auf jedes andere Anzeigegerät anwenden. Die "Verzögerung" ist genau das örtliche Verschieben nach rechts/links, das man mit der Feinjustage der Konvergenz durchführt. Es findet ein Resampling statt, genauso wie bei Audio, wenn man Verzögerungen kleiner als der Abstand der Samples haben möchte. Bei Audio ist es eben die Zeit, beim Bild der Ort.  |

|||||||

|

hotred

Inventar |

#26

erstellt: 07. Nov 2021, 13:22

|

||||||

|

Danke für eure interessanten Beiträge  @FoLLgoTT: Ich weiß nicht - ob ich dich bzw. deine Beiträge verstanden habe, versuche es aber einmal: Physikalische Pixel sind - wie der Name bereits sagt - physikalisch an einem bestimmen Ort und ändern diesen Ort auch im Falle eines Beamer über den wir hier sprechen nicht, soweit korrekt? Genau aus diesem Grund wurde die DIGITALE Konvergenzkorrektur entwickelt - um physikalisch "falsch" ausgerichtete (=weil nicht 100% deckungsgleiche) Pixel der Primärfarben wieder digital "ins Lot" zu bringen, korrekt? Genau das geschieht eben nun (im Gegensatz zu manchen Profigeräten wo das "mechanisch" möglich ist) digital durch "mischen" von benachbarten Pixel, korrekt? Wenn man also nun das grüne Pixel als "Referenz" annimmt - nach dem sich die roten und blauen ausrichten müssen - so wird also bei einer angenommenen Abweichung des blauen Pixel zur phsyikalischen Position des grünen "Referenz" Pixel das blaue digital (örtlich) "verschoben" - in dem man also das "benachbarte" Pixel sozusagen mit einbezieht und somit eine "Mischung" der Pixel initiiert um als Ergebnis ein fürs Auge möglichst örtlich "gewandertes" Pixel zu erreichen - korrekt? Es ist völlig klar das die einzelnen Pixel niemals wirklich ihre physikalische Position (= Anordnung zueinander) verändern - da dies eben ausschließlich durch eine mechanische Korrektur möglich wäre die bei üblichen consumer Geräten NICHT existiert. Kann man das etwa so zusammenfassen  Wie schätzt du nun also die Auswirkungen aufs Bild ein? [Beitrag von hotred am 07. Nov 2021, 13:24 bearbeitet] |

|||||||

|

FoLLgoTT

Stammgast |

#27

erstellt: 07. Nov 2021, 16:29

|

||||||

Vereinfacht ausgedrückt, ja.  Nur steckt dahinter mathematisch eben ein bisschen mehr. Mein Bild oben mit der Wellenform zeigt, was bei einer Verzögerung/Verschiebung mit den Samples/Pixels passiert und wie die korrekt rekonstruierte Wellenform dann aussehen würde. |

|||||||

|

hotred

Inventar |

#28

erstellt: 07. Nov 2021, 17:12

|

||||||

|

Ok vielen Dank - du bist in dem Bereich offenbar ein Experte oder zumindest sehr interessiert und deshalb weit überdurchschnittlich informiert  Wie schätzt du nun die praktischen Auswirkungen auf das Bild ein - denn das ist es ja letztlich was für uns hier interessant ist. |

|||||||

|

FoLLgoTT

Stammgast |

#29

erstellt: 07. Nov 2021, 17:40

|

||||||

Meine Erfahrungen damit sind eher negativ, daher benutze ich es nicht. Das Problem ist auch, dass z.B. Schärfealgorithmen (sofern man sie nutzt) im Grunde nach der Verschiebung ansetzen müssten. Ich halte aber die Konvergenzthematik ohnehin nicht für besonders kritisch. Da bin ich aus Röhrenzeiten ganz andere Verschiebungen gewöhnt und mit immer höherer Auflösung verschiebt sich das Problem in immer schlechter sichtbare Bereiche. |

|||||||

|

hotred

Inventar |

#30

erstellt: 07. Nov 2021, 17:48

|

||||||

|

Ok danke - das klingt absolut plausibel und schlüssig denke ich. Das bedeutet aber im Umkehrschluss auch das es schon relativ wichtig ist ein Gerät er erhalten mit guter Konvergenz ohne Korrektur (so man eben Wert auf gute Konvergenz legt). |

|||||||

|

Mankra

Inventar |

#31

erstellt: 08. Nov 2021, 09:26

|

||||||

|

Den Gedankensprung, wie ein Phasenverschub (in Längsrichtung der Bewegung) einen Versatz quer zur Bewegung, schaffe ich noch immer nicht. Egal, nochmal aus der Praxis: Der JVC verschiebt bei "Pixel" wirklich pro Klick um 2 Pixel Reihen/Spalten.........Ist leider zu grob. Ich würde 1px brauchen. Mit der Fein Einstellung wirken sich 8 Klicks 1 Pixel breit aus. Aber damit wird nicht, wie bei der Pixeleinstellung der Inhalt um eine Pixelreihe verschoben, sondern die Nebenpixel, min. 2px breit, farblich manipuliert. Was mit einem weißen Kreuz auf schwarzem Hintergrund noch gut aussieht, ergibt invertiert einen breiten, türkisen Saum. Zone hab ich mir gestern kurz angesehen: Zonen Korrektur ist nur per "Fein" Funktion möglich. D.h. nur mit dieser Farbmanipulation der Nachbarpixel. Somit IMHO der Nachteil klar in dieser Farbmanipulation. [Beitrag von Mankra am 08. Nov 2021, 09:27 bearbeitet] |

|||||||

|

*Harry*

Inventar |

#32

erstellt: 08. Nov 2021, 14:21

|

||||||

Das kann man nicht verallgemeinern. Zum Vergleich, warum ich nicht drauf verzichten könnte:     Ist unschwer zu erkennen, wo Zonenkorrektur an ist. Mit Korrektur wirken die LW-Bilder in diesem Fall klar schärfer und farbstimmiger. Wie gesagt, so macht das die X-Serie. Die N scheint andere Ergebnisse zu liefern, auch anders zu funktioneiren, wie Mankra schildert (8 Stufen für vollen Versatz eines 4K-Pixels). |

|||||||

|

*Harry*

Inventar |

#33

erstellt: 08. Nov 2021, 15:48

|

||||||

Es ist dennoch nur die Luminanz zweier physikalisch benachbarter Sub-Pixel gleicher Farbe, die in Bezug auf den Korrektur-Einstellwert geregelt wird, um uns eine "Strahlkorrektur" vorzugaukeln. Wenn sich beim N dann Farbfehler ergeben, ist das natürlich unbrauchbar. Wie auch immer - die elektronische (!) Konvergenzkorrektur kann einen mechanisch oder Optikbedingten, inhomogenen Strahlversatz nicht bis in jede kleinste Bildeigenschaft hinein ausmerzen. Irgendwo sind eben mal Grenzen der Machbarkeit. Mir war von Anfang an klar, dass im ungünstigsten Fall (also physikalischer Versatz um eine 0,5-fache Pixelgröße) zwangsläufig 2 Sub-Pixel anstelle von einem leuchten werden, wenn auch nur reduziert hell im Vergleich zu einem nicht korrekturbedürftigen Pixel gleicher Farbe. Aber seit ich die Korrektur gemacht habe, denke ich nicht mehr darüber nach, weil auf mich im Film nichts davon störend wirkt (ausgenommen Pixelreihe 1920 bzw. Zeile 1080, wo mir bei aktiver Korrektur die roten Pixel fehlen, weil die FW nicht weit genug durchdacht wurde). In irgend einem Pixel-Szenario werden wir also immer wieder mit den Aus- oder Nebenwirkungen der Konvergenzkorr. konfrontiert bleiben. Das Bild von Michael ist m. E. so ein typisches extrem-Beispiel (vlt. ist es ja auch nur durch die Kamera entstanden   ); es erinnert mich an die Diskussionen über FI-Artefakte, die je nach JVC-Generation mehr/weniger störend waren. ); es erinnert mich an die Diskussionen über FI-Artefakte, die je nach JVC-Generation mehr/weniger störend waren.M. E. ist es doch kein Beinbruch, einfach mal eine genaue Zonenkorrektur zu machen, um dann zu entscheiden, ob das eigene Projektormodell mit seinem individuellen Konvergenzversatz (keiner drüfte gleich sein) besser mit oder ohne aktivierter Zonenkorrektur das gefälligere Bild an die LW wirft. User mit 4K-Projektoren mögen hier evt. schneller an die Grenzen der Brauchbarkeit kommen. |

|||||||

|

Mankra

Inventar |

#34

erstellt: 08. Nov 2021, 18:55

|

||||||

Perfekt beschrieben

Ja leider ist eine einfache 1-Pixel Korrektur nicht möglich.

Das sicher, jedoch hier kommt die steigende Auflösung uns entgegen: Die Konvergenzkorrektur um einen ganzen UHD Pixel ist doppelt so genau wie bei FHD, ohne Nebenwirkungen. Hier ist auch noch die Frage, ob Shifter, die sowieso Pixel überlagern, nicht auch im Vorteil sind. Zumindest, wenn das Shifting "oben dazu" kommt, sprich UHD Shifter für BR-Darstellung, 8K Shiftung für UHDs. Und bei beiden JVC, die ich hatte ist die Konvergenz und Schärfe über die ganze Bildbreite erstaunlich gut gut ist. Da kann man nicht meckern.

Das Eine ist das Theoretisieren und Diskutieren, einzelne Faktoren zu ergründen. Die andere Geschichte ist, dass man für sich das beste Ergebnis raus holt (auch wenn es nicht immer mit der Theorie zusammenpaßt). Mich ärgert noch bißerl, dass ich das 1px Schachbrett nicht sauber auf die LW bekomme, d.h. aber nicht, dass ich beim Filme schauen die ganze Zeit darüber grübeln würde, oder gar auch da noch herum spielen würde. Ganz im Gegenteil: Film ab und abschalten  |

|||||||

|

George_Lucas

Inventar |

#35

erstellt: 09. Nov 2021, 08:16

|

||||||

Doch, das ist zu verallgemeinern, weil dieser Effekt bei allen nativen 4K-Projektoren exakt so vorkommt. Herstellerübergreifend. Reproduzierbar. Jederzeit. Konkret bedarf es allerdings spezielle dafür "anfällige" Inhalte. Das bedeutet: Das obige Bild in Full-HD-Auflösung zeigt diese farbigen Effekte beispielsweise nicht, weil der Schleier in Full-HD-Auflösung auf einem 4K-Projektor dann nicht die nötige feine Auflösung besitzt, damit die zonenbasierte angepasste Konvergenz derlei farbige Fehler verursacht. In farbigen Szenen fällt dieser Effekt noch weniger auf, gleichwohl er auch da vorhanden ist. Ich erkenne das regelmäßig in feinen Strukturen, die eigentlich grau sein sollen, aber durch diesen Effekt verfärbt auf der Leinwand erscheinen. Wie immer hat Gültigkeit: Alle digitalen Filterregelungen haben neben Vorteilen auch Nachteile, die in bestimmten Szenen/Bildern zu sehen sind - und auch diese Aussage lässt sich verallgemeinern. Die digitale zonenbasierte Konvergenzanpassung stellt keine Ausnahme dar. [Beitrag von George_Lucas am 09. Nov 2021, 08:20 bearbeitet] |

|||||||

| |||||||

|

|

||||

| Das könnte Dich auch interessieren: |

|

Beamer als "Fernseher" welche Vorteile welche Nachteile? bashar60 am 17.01.2004 – Letzte Antwort am 17.01.2004 – 2 Beiträge |

|

Digitale Bilder über Beamer rudi1 am 04.03.2007 – Letzte Antwort am 07.03.2007 – 12 Beiträge |

|

Welche Nachteile hat SXRD Technik /Wie anfällig ist diese Technik cane1972 am 03.09.2009 – Letzte Antwort am 17.11.2009 – 71 Beiträge |

|

Digitale Zuspielung: 720p oder 1080i schwarzer Rand? smacfew am 27.06.2005 – Letzte Antwort am 04.07.2005 – 4 Beiträge |

|

Epson EH-R 2000/4000 andeis am 06.11.2010 – Letzte Antwort am 04.05.2012 – 580 Beiträge |

|

tv signal über beamer - welche möglichkeiten gibt es? graveheart am 13.06.2006 – Letzte Antwort am 13.06.2006 – 4 Beiträge |

|

Vor- und Nachteile aller Full-HD-Beamer ab 2009 Louis-De-Funès am 14.09.2011 – Letzte Antwort am 14.09.2011 – 4 Beiträge |

|

PT-AE500 und welche Tasche? Masterbilly am 14.09.2004 – Letzte Antwort am 19.09.2004 – 6 Beiträge |

|

Welche Auflösung am BenQ PE5120 am besten? Hercules am 28.03.2005 – Letzte Antwort am 28.03.2005 – 2 Beiträge |

|

Welche Auflösung für Beamer? df7nw01 am 21.01.2005 – Letzte Antwort am 23.01.2005 – 13 Beiträge |

Foren Archiv

2021

Anzeige

Produkte in diesem Thread

Aktuelle Aktion

Top 10 Threads in Projektoren / Beamer der letzten 7 Tage

- JVC DLA-NP5 / NZ7, NZ8, NZ9

- Epson EH-LS11000 & EH-LS12000 2021 Laser, 3LCD, Shift 4k

- Deckenhalterung Beamer- Bild verkehrt herum?

- Wo Steckdosen in der Decke platzieren für meinen Beamer?

- XGIMI Horizon Pro Beamer Gespräche, Tipps und Tricks

- Beamer macht Lila bild pls help

- Fleck INNEN in der Linse!

- EPSON EH-TW7000 und EH-TW7100: 4K PRO-UHD Nachfolger der EH-TW6700 und EH-TW6800

- nebula capsule max mit apps bespielen

- Sony Beamer 2022 - VPL-XW5000ES - ( VPL-XW6000ES in Amerika ) / VPL-XW7000ES

Top 10 Threads in Projektoren / Beamer der letzten 50 Tage

- JVC DLA-NP5 / NZ7, NZ8, NZ9

- Epson EH-LS11000 & EH-LS12000 2021 Laser, 3LCD, Shift 4k

- Deckenhalterung Beamer- Bild verkehrt herum?

- Wo Steckdosen in der Decke platzieren für meinen Beamer?

- XGIMI Horizon Pro Beamer Gespräche, Tipps und Tricks

- Beamer macht Lila bild pls help

- Fleck INNEN in der Linse!

- EPSON EH-TW7000 und EH-TW7100: 4K PRO-UHD Nachfolger der EH-TW6700 und EH-TW6800

- nebula capsule max mit apps bespielen

- Sony Beamer 2022 - VPL-XW5000ES - ( VPL-XW6000ES in Amerika ) / VPL-XW7000ES

Top 10 Suchanfragen

Forumsstatistik

- Registrierte Mitglieder928.687 ( Heute: 2 )

- Neuestes Mitgliedgr2025

- Gesamtzahl an Themen1.558.756

- Gesamtzahl an Beiträgen21.709.948